С развитием искусственного интеллекта появились новые технологии, которые можно использовать как во благо, так и во вред. Одной из самых нашумевших технологий последних лет являются дипфейки.

Разберёмся, что такое дипфейки, как они работают, и почему они представляют серьёзную угрозу для современного мира.

- Что такое дипфейк?

- Как работают дипфейки?

- Типы данных, которые подделывают дипфейки

- Угрозы, связанные с дипфейками

- Политическая дезинформация

- Компрометация репутации

- Мошенничество в корпоративной среде

- Злоупотребление социальной инженерией

- Статистика преступлений с дипфейками

- Методы борьбы с дипфейками

- Использование ИИ для обнаружения фальшивок

- Регулирование законодательства

- Повышение осведомлённости пользователей

- Заключение

Что такое дипфейк?

Дипфейк (от англ. deep learning – «глубокое обучение» и fake – «подделка») — это сочетание технологий глубокого обучения нейросетей генерации фальшивого медиа/аудио контента. Наиболее распространённая форма — это видео, где лицо или голос человека заменяется другим, создавая иллюзию, что он говорит то, чего на самом деле не было.

Примером может служить видео с публичной личностью, где она произносит слова, которые она никогда не говорила. Технология может быть использована для создания фальшивых новостей, компрометирующих видеоматериалов или шантажа.

Технология дипфейков стала особенно популярной в 2017 году с появлением доступных инструментов на базе ИИ для создания подобных материалов.

Как работают дипфейки?

Основу дипфейков составляет нейросети, которая обучается на большом количестве данных (например, видео с лицом человека). После обучения она может встраивать это лицо в другие видео, изменяя выражения и движения с высокой степенью точности.

Этот процесс состоит из нескольких этапов:

- Сбор данных: Технология дипфейков требует большого количества данных, будь то видео или аудиозаписи, с лицом или голосом целевого человека.

- Обучение нейросети: Нейросети обучаются на этих данных для того, чтобы они могли воссоздать все детали, включая мимику, тон голоса и движения.

- Создание фальшивого контента: После обучения алгоритм может генерировать реалистичные видео или аудиофайлы, которые кажутся аутентичными.

Современные дипфейки настолько продвинуты, что их сложно обнаружить с помощью стандартных инструментов верификации контента.

Типы данных, которые подделывают дипфейки

Дипфейки могут быть использованы для создания различных видов фальшивых медиа и аудио:

Видео: Лица людей в реальных видео заменяются на другие, что может ввести в заблуждение.

Аудио: Используя технологии синтеза речи, дипфейки могут создавать аудиозаписи с голосом любого человека.

Фотографии: Создание поддельных изображений с заменой лица.

Угрозы, связанные с дипфейками

Дипфейки представляют собой не только технологический прорыв, но и серьёзную угрозу. Вот основные риски, которые связаны с их использованием:

Политическая дезинформация

Дипфейки могут быть использованы для создания фальшивых видео с политическими деятелями, в которых они якобы делают заявления или совершают действия, которые могут существенно повлиять на общественное мнение. Такие видео могут вызвать широкую общественную реакцию и привести к недоверию в отношении политиков.

Это способно дестабилизировать политическую обстановку в стране, спровоцировать протесты или социальные волнения. Более того, в международной политике такие фальшивые видео могут послужить катализатором для возникновения конфликтов между государствами.

Компрометация репутации

Один из самых частых сценариев использования дипфейков — это создание порочащих видео с участием знаменитостей, политиков или частных лиц. Такие фальшивые видео могут быть использованы для шантажа или подрыва репутации человека, нанося ему серьёзный моральный и материальный ущерб.

Примеры подобных фальшивых материалов встречаются в различных сферах, включая использование дипфейков в порнографическом контексте, где лица известных людей подделываются и встраиваются в недостоверные сцены.

Мошенничество в корпоративной среде

Дипфейки всё чаще применяются для проведения мошеннических атак в корпоративной среде. Преступники могут создать поддельное видео с руководителем компании и использовать его для передачи ложных распоряжений сотрудникам.

Такие атаки могут привести к значительным финансовым потерям, поскольку фальшивые запросы на перевод средств или передача конфиденциальной информации могут показаться полностью правдоподобными.

Злоупотребление социальной инженерией

Дипфейки также становятся инструментом социальной инженерии. Злоумышленники могут создавать фальшивые видеозвонки или голосовые сообщения от имени коллег, руководителей или даже близких людей, что может ввести жертв в заблуждение.

Подделки такого рода часто используются для кражи данных, хищения корпоративной информации или даже финансовых средств, причём жертвы зачастую не подозревают о манипуляции до тех пор, пока не станет слишком поздно.

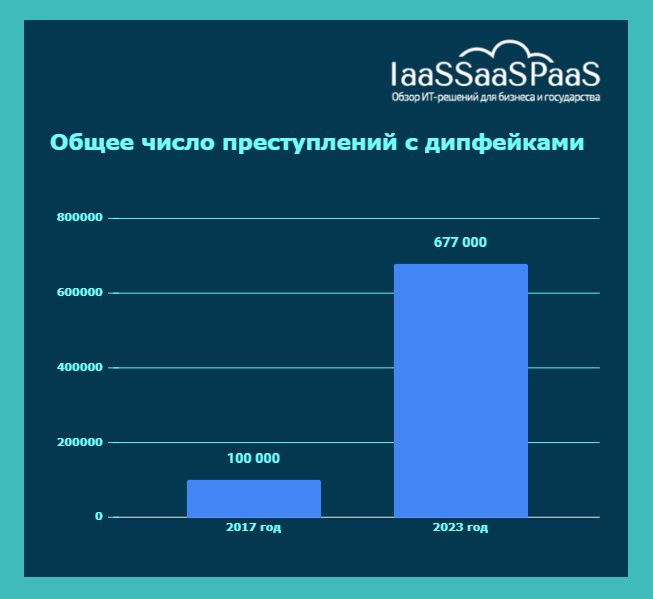

Статистика преступлений с дипфейками

По сравнению с 2017 годом число видеодипфейков в интернете к 2023 выросло в 3 раза, а аудиодипфейков — в 8 раз. В 2017 году общее число преступлений фиксировалось на уровне чуть менее 100 тыс. случаев, а в 2023 году юристы получили свыше 650 тыс. подобных кейсов. Их доля от общего числа преступлений составляет уже более 34%.

Методы борьбы с дипфейками

С развитием технологии дипфейков появляется всё больше методов их обнаружения. Однако борьба с ними требует комплексного подхода, который включает:

Использование ИИ для обнаружения фальшивок

Клин клином. Для борьбы с дипфейками также используются технологии искусственного интеллекта. Они анализируют мельчайшие детали изображения и звука, которые невозможно подделать полностью, например, микроэмоции, тени и тонкие несовершенства в движениях.

Регулирование законодательства

Во многих странах уже разрабатываются законы, которые ограничивают использование дипфейков в политической рекламе и медиа.

Власти США уже был разрабатывали законопроект под названием No Fakes, однако его ещё не приняли. Этот документ направлен на запрет создания цифровой копии человека без его согласия. Основная цель законопроекта — защита интересов актёров и певцов, так как он включает исключения для новостных сюжетов, рекламы и биографических фильмов.

Согласно концепции законопроекта, запрет на использование образа человека действует на протяжении всей его жизни и ещё 70 лет после его смерти. По истечении этого срока использование цифровой копии будет запрещено, и даже родственники не смогут дать разрешение на это.

В марте 2024 года министр внутренних дел Владимир Колокольцев поручил усилить ответственность за преступления, связанные с использованием ИТ-технологий, включив их в перечень отягчающих обстоятельств Уголовного кодекса России. Кроме того, в феврале 2024 года была создана правительственная комиссия, которая поручила Минцифры, МВД и Роскомнадзору разработать новые меры по правовому регулированию технологии дипфейков, чтобы предотвратить их использование в противоправных целях.

Что касается уголовной ответственности, дипфейки уже могут подпадать под статью 159 УК РФ о мошенничестве, а также под статью 163 УК РФ о вымогательстве, если их использование связано с попытками получения выгоды или угрозами.

Повышение осведомлённости пользователей

Помимо обучения распознаванию дипфейков, важно развивать критическое мышление и навыки проверки источников информации. Пользователи должны быть внимательны к необычным деталям в видео и аудио, таким как неестественные движения губ, странные паузы в речи или несоответствия в тенях. Также полезно использовать специальные инструменты и платформы, которые могут анализировать медиафайлы на предмет подлинности.

Осведомленность о существующих рисках и регулярное обновление знаний о новых методах создания фейков помогает людям оставаться более защищёнными в цифровом пространстве.

Заключение

Дипфейки — это мощный инструмент, который может быть использован как для развлечений, так и для серьёзных преступлений. В мире, где визуальная и звуковая информация является одним из ключевых источников коммуникации, появление фальшивок такого уровня ставит новые вызовы для безопасности, политики и бизнеса.

Чтобы минимизировать риски, важно развивать технологии для распознавания дипфейков и вводить правовые механизмы, которые защитят людей и компании от возможных последствий их использования.